Système robotisé, obligations de l’intégrateur et de l’entreprise.

Présentation générale

Si les systèmes robotisés ou robots collaboratifs suscitent un grand intérêt dans le monde de l’entreprise, les obligations juridiques de l’intégrateur et celles de l’entreprise ne sont pas toujours connues.

Depuis la fin des années 1990, le terme « cobot » est utilisé pour désigner un « dispositif passif d’assistance à l’effort et manipulé directement par un opérateur ». Ce terme a été introduit pour désigner des systèmes robotisés collaboratifs également dénommés des applications collaboratives robotisées ou des systèmes cobotiques ou encore des applications collaboratives robotisées. Pour faciliter la compréhension de cet article et par simplification, nous utiliserons les expressions » système robotisé » mais également l’expression « cellule robotisée » ou encore celle de « robotique collaborative ». Aujourd’hui de nombreux scientifiques considèrent qu’un système robotisé à l’intersection de plusieurs domaines qui sont la robotique, l’ergonomie et la cognitique.

Beaucoup y voient une possibilité d’améliorer la productivité ou la qualité. Si cette technologie suscitent encore de nombreuses questions diverses sur la robotique cobotique, se posent également des questions d’encadrement juridique relatives à l’intégration de robots collaboratifs dans l’espace de travail des opérateurs humains.

Nous ne traitons pas du cas d’usage de l’entreprise choisissant un robot standard sur le catalogue d’un fabricant de robot afin de l’installer directement sans aucunes modifications. En effet dans ce cas, la relation existante entre l’employeur et le fabricant, est souvent régi par un contrat de vente.

Nous évoquerons la relation qui lie une entreprise et un intégrateur, lorsque un entrepreneur souhaite intégrer à sa chaîne de production un système robotisé totalement adapté à ses besoins. La relation entre l’entreprise et l’intégrateur est alors encadrée sur le plan juridique par un contrat d’intégration de système robotisé. Le contrat qui lie l’entreprisse et l’intégrateur est un contrat de prestations de services ou de louage d’ouvrage.

1. Les prérequis de l’entreprise qui souhaite intégrer un système robotisé

L’intégration d’un système robotisé peut répondre à différents objectifs tels que l’amélioration de la productivité ou des conditions de travail, l’accroissement de la performance industrielle ou encore l’amélioration de la qualité ou de la logistique de production. Les raisons peuvent également résulter de la volonté de relocaliser une production, une filière ou un écosystème industriel d’un pays étranger en Europe, ou encore de résorber les problématiques résultant de transferts de technologies.

De nombreuses enquêtes auprès d’utilisateurs de systèmes robotisés, donnent des informations intéressantes sur leurs besoins, et leurs perceptions des apports potentiels en matière de robotique collaborative. Une fois ses besoins identifiés, l’entreprise qui souhaite intégrer une ou plusieurs un ou plusieurs robots robotisés à son processus de production en vue de la réalisation d’une ou de plusieurs étapes de production, doit prendre considération dans sa démarche :

– la détermination de l’activité ou de l’étape partielle ou totale de la production pour laquelle elle souhaite intégrer un ou plusieurs système(s) robotisé(s) (§1.1) ;

– en outre, elle doit conduire une réflexion sur l’activité ou l’étape de production à robotiser, afin de déterminer ses besoins d’assistance de(s) opérateur(s), en fonction de ses process industriel ou de son activité ainsi que le degré d’interaction souhaité entre l’homme et le robot et les objectifs d’amélioration identifiés par l’entreprise (§1.2) ;

– elle doit également vérifier les conditions d’acceptation par les salariés de l’introduction d’un système robotisé dans son processus de production (§1.3) ;

– et enfin, elle doit sélectionner et choisir l’intégrateur de du système robotisé (§1.4).

1.1 L’identification de l’activité ou de l’étape de production à robotiser

L’identification de l’activité de production à robotiser est la première étape après la prise de décision de l’entreprise de robotiser une ou plusieurs activités ou étape(s) de production.

Cette identification va avoir des conséquences directes ou indirectes sur les objectifs de robotisation poursuivis. En effet, les objectifs choisis pour robotiser peuvent être multiples. Il peut s’agir de l’amélioration des conditions de travail, ou de la qualité et de la productivité. Les objectifs peuvent aussi des conséquences sur la détermination de l’activité de production ou les étapes à robotiser et sur le type de robotisation et le type de collaboration homme-machine à mettre en œuvre pour atteindre les objectifs justifiant la décision de robotiser.

1.2 L’identification des besoins de production à robotiser et des modes opératoires

Différentes formes de collaboration et donc d’interactivité entre l’homme et l’application collaborative robotisée peuvent être envisagés, de la simple coexistence entre l’opérateur et le système robotisé sur une étape ou une activité du mode de production jusqu’à l’assistance physique au geste ou à la manipulation ou au recours à une système d’assistance physique dirigé par l’opérateur.

L’opération ou l’ensemble des opérations à robotiser peuvent nécessiter de mettre en œuvre différents modes d’interactions entre l’opérateur et le système robotisé.

La classification des systèmes robotiques est difficile dans la mesure où il existe de nombreux critères pour décrire la collaboration entre un opérateur humain et un robot. En effet, certaines classifications excluent la composante humaine tandis que d’autres distinguent selon le rôle de l’humain.

Pour une classification en fonction du rôle de l’humain, il est possible de distinguer 3 types d’interaction entre les applications collaboratives robotisées, les opérateurs humains et les équipements de production périphériques :

– la coexistence,

– la coopération

– et la collaboration avancée.

D’autres chercheurs utilisent également les notions de :

– collaboration directe entre l’opérateur et le robot collaboratif,

– collaboration indirecte entre l’opérateur et le robot travaillant sur une même tâche ou pièce,

– partage d’espace de travail, dans lequel l’opérateur humain et le robot effectuent des tâches distinctes pour lesquelles ils peuvent être amenés à partager leur espace de travail.

Certaines applications collaboratives robotisées accomplissent des actions ou tâches avec le concours d’opérateurs humains, d’autres fonctionnent au contraire de manière totalement autonome dans une enceinte grillagée et protégée de toute intervention humaine.

1.3 L’acceptation par les salariés de l’entreprise du système robotisé

Au regard de mon retour d’expérience, il a pu être constaté à l’occasion de projets sur lesquels un accompagnement a été réalisé, que les objectifs poursuivis par l’entreprise peuvent se heurter à l’inacceptation des salariés de l’entreprise. C’est la raison pour laquelle, il est fortement recommandé d’associer dès le début du projet de robotisation les salariés afin de travailler sur les finalités de la robotisation, de penser la conduite des processus de production dès la conception et d’éviter les phénomènes de refus d’acceptation en cours de projet d’intégration du système robotisé.

La finalité choisie pour justifier la décision de robotiser peut avoir des conséquences sur l’emploi des salariés ou sur la modification des conditions de travail d’un ou de plusieurs salariés. Si la finalité de la robotisation est de substituer totalement à un opérateur une cellule robotisée, l’entreprise devra mettre en œuvre des actions d’accompagnement et de formation à la transformation du métier de l’opérateur, dont l’activité sera assurée entièrement par l’application collaborative à l’issue du processus d’intégration du système robotisé.

Cette étape consistant à expliquer les finalités de l’opération de robotisation et à s’assurer de l’acceptabilité des salariés/opérateurs est souvent oubliée soit l’impact de l’évaluation de l’acceptabilité est trop souvent minimisé dans la démarche d’intégration d’une application collaborative robotisée. Or, cette lacune peut avoir d’importantes conséquences lorsque l’employeur devra déterminer les besoins de production et surtout définir les modes opératoires qu’il souhaite mettre en place ou faire évoluer au sein de son organisation.

La question de l’acceptabilité est également essentielle dans la mesure où l’intégration d’un Système robotisé devrait conduire l’entreprise-employeur à penser la conduite des processus avec des individus en parfaite harmonie avec le Système robotisé. Or, pour cela, un travail important devra être réalisé sur l’ergonomie des postes de travail dès la conception de la chaîne de production sur laquelle le Système robotisé sera intégré.

1.4 Le choix de l’intégrateur du système robotisé

A l’issue de la réalisation des étapes 1.1 à 1.3 ci-dessus, l’entreprise doit identifier les différents intégrateurs du marché et faire le choix de retenir un intégrateur pour son projet de robotisation. Le rôle de l’intégrateur est déterminant dans la mesure où son rôle est comparable à celui d’un architecte chargé de définir les plans d’une construction et le suivi du déroulement des travaux de construction de l’ouvrage jusqu’à la réception de l’ouvrage.

2. Différentes obligations de l’intégrateur d’un système robotisé

Le contrat entre l’entreprise et l’intégrateur doit nécessairement définir les obligations contractuelles de l’intégrateur vis-à-vis de l’entreprise cliente donneuse d’ordre souhaitant s’engager dans un projet de robotisation. Nous décrirons le contenu et la nature des principales obligations de l’intégrateur après la présentation du cadre légal et normatif applicable.

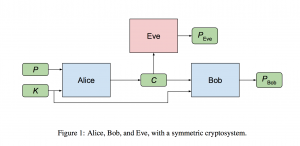

2.1 Le cadre légal résultant de la directive Machines

Tout projet d’intégration d’un système robotisé commence par une analyse des risques conformément aux principes généraux de prévention énoncés dans l’annexe I de la directive « Machines » (Directive 2006/42/CE).

La directive 2006/42/CE relative à la conception des machines, transposée en droit français aux articles R. 4311-4 et suivants, R. 4312-1 et suivants ainsi qu’aux articles R. 4313-1 et suivants du code du travail, prévoit une obligation d’évaluation des risques par les fabricants.

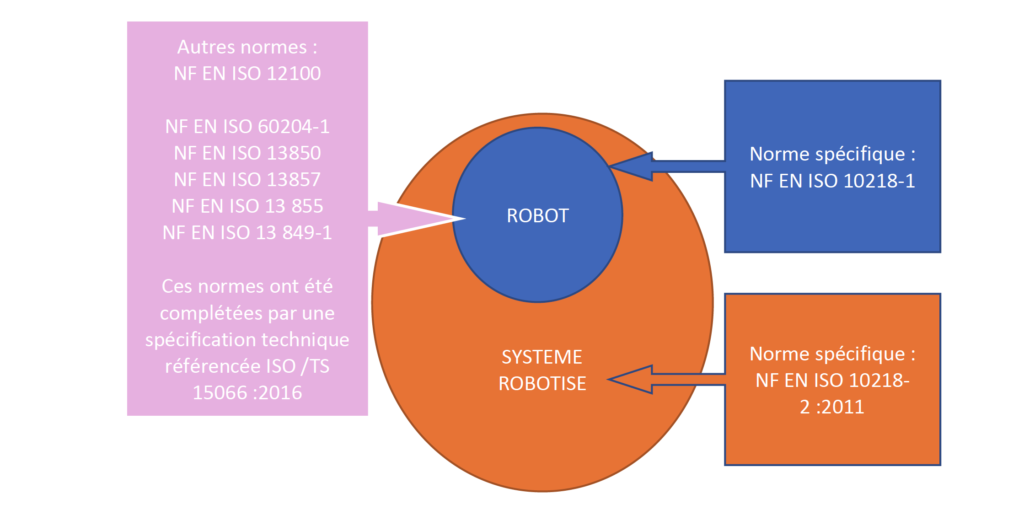

2.2 Le cadre normatif : les normes harmonisées

L’application des normes est par principe d’application volontaire conformément aux dispositions de l’article 17 du décret du 16 juin 2009 relatif à la normalisation. Les normes harmonisées NF EN ISO 10218-1 et 10218-2 : 2011 permettent aux fabricants de robots d’évaluer les risques et la conformité de leurs produits avec les exigences essentielles décrites à l’annexe 1 de la directive Machines. Ces normes précisent les principes techniques qui sont combinables entre eux et à choisir en fonction de la situation de l’arrêt nominal de sécurité contrôlé, du guidage manuel, du contrôle de la vitesse et de la distance de séparation, de la limitation de la puissance et de la force du robot en cas de contact avec un humain.

Système robotisé schéma du cadre légal et normatif

Les caractéristiques des éléments de sécurité varient selon le niveau d’interactivité nécessaire entre les opérateurs-humains et le système robotisé. Les différents éléments de sécurité du système robotisé sont définis aux articles 5.11.5.2 à 5.11.5.5. de la norme NF EN ISO 10218-2.

L’intégrateur, volontairement ou pour donner suite à l’obligation contractuelle de conformité aux normes (cf. §2.3.4) prévue au contrat le liant à sa cliente, pourra faire application :

– de la norme NF EN ISO 10218-2 pour réaliser un Système Robotisé intégrant un robot (à la norme NF EN ISO 10218-1) ;

– de la norme NF EN ISO 12100 pour identifier les phénomènes dangereux et évaluer les risques (Articles 4.2 et 4.4 Norme NF EN ISO 12100) ;

– de la méthode en 3 étapes pour réduire les risques identifiés (Article 4.5 de la norme NF EN ISO 12218-2) et intégrer des mesures techniques pour réduire les risques (Article 5 de la norme NF EN ISO 12218-2) ;

– de la norme NF EN ISO 10218)2 pour la rédaction des informations d’utilisation du Système Robotisé.

2.3 Les obligations de l’intégrateur d’un système robotisé

L’intégrateur qui a été choisi par une entreprise pour concevoir un système robotisé totalement adapté à ses besoins est soumis à de nombreuses obligations, qu’il convient de faire figurer dans le contrat d’intégration (Contrat de prestations de services ou contrat de louage d’ouvrage).

2.3.1 L’obligation d’information, de conseil et de mise en garde

L’intégrateur, comme tout professionnel dans les domaines de l’informatique ou des communications électroniques, à une obligation d’information, de conseil et de mise en garde de l’entreprise cliente.

Cette obligation d’information, d’alerte et de mise en garde est essentielle dans la mesure où l’intégrateur devra être particulièrement vigilant sur les éléments d’informations techniques fournies par le fabricant du robot ou du système robotisé.

Certains éléments de sécurité sont réalisés par association d’une fonction standard avec une fonction de surveillance, ce qui impose à l’intégrateur de bien évaluer leurs comportements en cas de dysfonctionnement.

2.3.2 L’obligation d’analyse globale des risques liés au fonctionnement du système robotisé ainsi qu’au poste et à l’environnement du poste de travail

La mise en place d’un système robotisé nécessite une étape d’identification et d’analyse globale des risques liés à l’environnement de travail de l’opérateur et à l’utilisation du système robotisé.

L’analyse des risques implique de réaliser une analyse de la situation de travail. Cette analyse prend en compte les gestes opératoires, les tâches à réaliser, l’environnement du poste de travail ainsi que les contraintes liées au travail et enfin les objectifs attendus par l’entreprise.

A titre d’illustration, la limitation de la vitesse des mouvements du robot est une fonction de sécurité si elle est associée à une fonction de surveillance qui supprime le risque lors de la détection d’un dépassement d’un seuil de vitesse estimé dangereux.

Sur la base des informations qui lui auront été communiquées par l’employeur (après avoir réalisé l’évaluation des risques pour la santé et la sécurité de ses personnels), l’intégrateur va pouvoir réaliser à son tour une analyse relatives aux :

– risques liés au fonctionnement du système robotisé : dans deux séries de configuration : en marche normale et en cas de défaillance matérielle et/ ou logicielle ou de perte de contrôle ou de fonctionnement erratique ou de dysfonctionnement fugitif ;

– risques liés au poste de travail : tels que les atteintes à la sécurité des personnes (contact physique, écrasement, projection,) et les nuisances susceptibles d’altérer la santé ou la nature des tâches réalisées par l’opérateur ;

– risques liés à l’environnement du poste de travail : tels que les conditions d’installation, les obstacles liés aux locaux, la coactivité avec d’autres équipements, les chemins de circulation des autres personnels ou tiers dans l’espace de travail.

Cette évaluation des risques par l’intégrateur permet de déterminer les facteurs de gravité pour la santé et la sécurité des personnes ainsi que le niveau de performance de sécurité requis pour le choix des éléments de sécurité (mesures de prévention).

Les Exigences Essentielles de Santé et de Sécurité (EESS) de la directive Machine sont définies à l’EESS 1.1.6 et 1.3.7. Nous ne détaillons pas ici l’ensemble des exigences essentielles de santé et de sécurité (EESS) à prendre en compte.

L’identification des phénomènes dangereux du système robotisé.

Pour l’application collaborative robotisée identifiée par l’employeur lors de la phase d’expression des besoins, l’intégrateur devra également identifier l’ensemble des phénomènes dangereux du système robotisé. Cette identification pourra être réalisée par l’intégrateur en appliquant les stipulations de la norme NF EN ISO 12100 qui permet de prendre en compte tous les phénomènes dangereux (ceux qui proviennent des éléments mobiles du système robotisé, l’ensemble des dispositifs annexes liés à la production, ceux qui proviennent des outils/pièces manipulées ou transportées par le système robotisé` ;

L’analyse des risques relatifs à l’environnement du système robotisé.

L’intégrateur devra également réaliser l’analyse des risques relatifs à l’environnement du système robotisé. Cette analyse doit être conduite en étroite collaboration avec l’employeur dans la mesure où il s’agit de déterminer les conditions d’installation du système robotique sur la chaîne de production en tenant compte de l’ensemble du processus de production mais aussi des espaces de travail, des manutentions et des risques liés au processus de production.

Il incombe à l’intégrateur de choisir et combiner les éléments de sécurité mais également de rechercher s’il est nécessaire d’utiliser d’autres moyens de sécurité pour parvenir au niveau de sécurité requis pour le système robotisé à mettre en œuvre en fonction des besoins définis par l’entreprise lors de l’étape d’expression de ses besoins.

2.3.3 L’obligation de garantie de la sécurité et de la fonctionnalité du système robotisé

L’intégrateur doit contractuellement s’engager sur une obligation de garantie de la sécurité et de la fonctionnalité du système robotisé.

Les robots collaboratifs comportent des éléments en mouvement (bras, pinces, outils, pièces manipulées) susceptibles d’engendrer :

– des risques d’impacts physiques (écrasement, choc…) ;

– des risques spécifiques (brûlures, intoxications, vibrations…).

À ces risques peuvent également s’ajouter des contraintes physiques et psychiques à l’origine notamment de :

– troubles musculo-squelettiques (TMS) (douleurs aux poignets, dos…) ;

– risques psychosociaux (surcharge mentale, isolement, fatigue, stress…).

La démarche d’intégration de système robotisé impose la prise en compte de l’ensemble de ces risques par la mise en place de principes techniques accompagnés de mesures organisationnelles.

Dans une synthèse de travaux réalisés à l’international intitulée « Prévention dans le domaine de la robotique collaborative », Eurogip a identifié une liste des principaux risques. Parmi les accidents du travail, Eurogip a identifié les collisions et les écrasements. La limitation ou la contrainte des mouvements de l’opérateur peuvent être des sources de troubles musculo-squelettiques (TMS). D’autres risques physiques sont liés à la cybersécurité et à la maintenance : reprogrammation malveillante, mauvais usage des commandes et des fonctionnalités du cobot, sécurisation défectueuse ou insuffisante lors de la maintenance.

Les risques psychosociaux, sont également présents, et trouvent leur origine dans différentes situations : la vigilance permanente sur le système robotisé, l’augmentation des cadences, la surcharge d’informations, la perte d’autonomie sont autant de facteurs de stress.

Les risques listés ci-après doivent être l’objet de l’obligation de garantie de sécurité de l’intégrateur à faire figurer dans le contrat liant l’intégrateur et son client.

Le tableau ICI dresse la liste des risques, leurs origines et leurs conséquences. Ce tableau a été établi par l’INRS.

Une infographie réalisée par l’INRS présente également une synthèse des principaux risques associés à la robotique collaborative ainsi que les solutions techniques adaptées.

L’intégrateur peut implémenter quatre types distincts d’éléments de sécurité (mesures de prévention des risques) suite à l’analyse des risques :

– un arrêt contrôlé nominal de sécurité (Norme NF EN ISO 10218-2, §5.11.5.2) ;

– un guidage manuel (Norme NE EN ISO 10218-2, §5.11.5.3) ;

– une surveillance de la vitesse et de la distance de séparation avec l’opérateur (Norme NF EN ISO 10218-2, §5.11.5.4);

– la limitation de la puissance et de la force, par conception ou par commande (Norme NF EN ISO 10218-2, §5.11.5.5).

2.3.4 L’obligation de détermination des mesures de prévention adaptées aux risques du système robotisé

Pour le système robotisé envisagé avec l’entreprise, l’intégrateur doit déterminer les mesures de prévention contre les risques identifiés. L’ensemble des mesures de prévention tels que définis dans la norme NF EN ISO 20218-2 : 2011 peuvent être utilisées. L’intégrateur doit déterminer pour un environnement donné, le choix des degrés de proximité ou d’éloignement selon les risques ainsi que l’espace nécessaire au système robotisé et la conception de la cinématique des mouvements.

Si des risques subsistent dans l’espace de travail, l’intégrateur devra déterminer les autres mesures de prévention telles que définies dans la norme NF EN ISO 10218-2 :2011 au paragraphe 5.10.

L’analyse du risque global et itérative du poste de travail, de l’espace de travail, permet à l’intégrateur d’identifier si une mesure de prévention de sécurité (n°4) doit être mise en œuvre.

3. Les obligations de l’employeur intégrant un système robotisé

Les obligations auxquelles sont soumises l’employeur d’un système robotisé sont nombreuses. Le respecte de ses obligations est essentiel pour que le projet d’intégration d’un système robotisé arrive à son terme dans de bonnes conditions de collaboration mutuelle entre l’intégrateur et l’entreprise cliente.

La responsabilité juridique de l’employeur est fondée sur les dispositions de l’article L.4321-2 du code du travail qui dispose que :

« Il est interdit de mettre en service ou d’utiliser des équipements de travail et des moyens de protection qui ne répondent pas aux règles techniques de conception du chapitre II et aux procédures de certification du chapitre III du titre Ier » du code du travail.

3.1 L’obligation de détermination des moyens de production et des modes opératoires à mettre en place ou à faire évoluer

Dans le cadre de la démarche d’analyse des risques (décrite au §2.3.2 ci-dessus) qui est réalisée par l’intégrateur, l’entreprise donneur d’ordre ne joue pas un rôle passif.

Durant cette étape, l’entreprise-employeur doit déterminer ses besoins de production et définir les modes opératoires souhaités qu’il s’agisse de modes opératoires existants à faire évoluer ou de modes opératoires à mettre en place.

Or, cette étape est cruciale, dans la mesure où la nature et les caractéristiques de sécurité du fonctionnement du système robotisé qui seront définies par l’intégrateur, dépendent étroitement des besoins exprimés par l’entreprise-employeur.

L’entreprise-employeur doit parfaitement formuler ses besoins dans un cahier des charges.

La collaboration directe ou indirecte entre un système robotisé et un opérateur humain est un mode de fonctionnement particulier partageant un même espace de travail. Or, tous les robots ne sont pas adaptés pour un mode opératoire collaboratif. Seuls les robots adaptés, selon le paragraphe 3.2 de la norme NE EN USO 10218-2 : 2011 sont utilisables pour un mode collaboratif. Cela suppose de définir une ou des tâches prédéterminées, qui doivent être rendues réalisables lorsque toutes les mesures de prévention identifiées par l’intégrateur sont actives, par un système robotisé ayant des caractéristiques spécifiquement conçues et adaptées pour ce mode opératoire.

Le projet d’intégration devrait conduire l’employeur à travailler sur l’ergonomie des postes de travail dès la conception de la chaîne de production. La définition des besoins doit également inclure l’expression de besoins sous l’angle de la sécurité au travail.

L’employeur doit également prendre en compte dans son cahier des charges, les éléments d’information qui sont susceptibles d’impacter la productivité tels que l’augmentation des distances de sécurité entraînant ou non la réduction des espaces de travail, les arrêts ou ralentissements intempestifs pouvant entraîner des baisses de productivité. `

Le résultat de l’exécution de cette obligation par l’employeur lui permet de réaliser la phase d’étude des tâches qui seront attribuées au système robotisé et du rôle de l’opérateur humain.

3.2 L’obligation de collaboration de l’employeur avec l’intégrateur du système robotisé

L’entreprise-employeur doit collaborer avec l’intégrateur durant toute la durée du projet d’intégration du système robotisé. En particulier, l’entreprise-employeur doit collaborer durant la première étape qui est celle de l’analyse des risques.

3.3 L’obligation d’évaluer les risques pour la santé et la sécurité de ses personnels

En application des articles L.4121-2 et 3 du code du travail, l’employeur a l’obligation de procéder à l’évaluation des risques pour la santé et la sécurité de ses personnels. En fonction de cette évaluation des risques, l’employeur doit également adapter le processus de travail des opérateurs en ce qui concerne la conception et l’ergonomie des postes de travail, le choix des équipements et des méthodes de travail. Il lui incombe également de planifier les éléments de prévention, en y intégrant la technique, l’organisation du travail et les conditions de travail de manière cohérente.

Si l’employeur remplit correctement cette obligation légale, il sera en mesure de fournir les éléments d’information qui seront pris en compte par l’intégrateur pour l’évaluation à son tour des risques liés au fonctionnement du système robotisé mais aussi des risques relatifs au poste de travail et à l’environnement de travail de l’opérateur.

3.4 L’obligation de formation et de maintien des compétences des opérateurs à l’exploitation du système robotisé

Avant la mise en production du système robotisé, l’entreprise-employeur doit veiller à former les opérateurs travaillant dans l’espace de travail partagé avec le système robotisé. L’employeur devra également maintenir les compétences des opérateurs, de l’ensemble des personnels exerçant des tâches dans l’espace de travail partagé avec le système robotisé.

3.5 L’obligation de maintien en conformité du système robotisé

Pendant toute la durée de l’exploitation du système robotisé, l’entreprise-employeur doit maintenir en conformité le système robotisé.

Dans les cas où seraient identifiées des modifications par rapport à la configuration d’exploitation initialement mise en œuvre par l’intégrateur, l’entreprise-employeur a l’obligation d’initier soit une mise à jour soit une nouvelle procédure d’analyse de risques, comparable à celle réalisée par l’intégrateur lors de la phase de conception du système robotisé (cf.§2.3.2 ci-dessus).

3.6 L’obligation de résultat de sécurité du système robotisé

Pèse sur l’employeur une obligation de résultat de sécurité impliquant pour l’employeur de mettre en place l’ensemble des procédures de sécurité, de vérification et de veille et du respect des consignes d’utilisation rédigées par l’intégrateur.

L’employeur a l’obligation de définir clairement dans les fiches de postes des opérateurs, le périmètre d’intervention, la prévention des usages inadaptés, l’organisation des retours d’expérience résultant de l’observation des postes de travail ainsi que des échanges directs avec les opérateurs.

Le maintien de l’obligation de résultat de sécurité impose nécessairement de définir et mettre en place des procédures de veille sur les dysfonctionnements et les incidents relatifs aux anomalies ou défaillances des dispositifs de sécurité intégré au système robotisé.

4. Les mécanismes de responsabilité des acteurs

Les différents acteurs qui interviennent dans la mise en œuvre des règles de conception et d’utilisation d’une machine (au sens du code du travail) sont :

– le fabricant du robot ou son mandataire, responsable de la mise sur le marché ;

– l’intégrateur, architecte de la conception et fabrication du système robotisé, et de l’ensemble des outils utilisés par le robot et qui assure la maîtrise d’œuvre globale du projet de système robotisé ; L’intégrateur qui n’intervient que sur une partie seulement du projet d’intégration du système robotisé n’a pas la qualité de maître d’œuvre global du projet de système robotisé.

– L’employeur qui met à disposition de ses opérateurs le système robotisé qui à l’obligation de former ou monter en compétences ses opérateurs et d’assurer le maintien de la conformité du système robotisé. L’employeur peut prendre la qualité de fabricant et de maître d’œuvre global du projet s’il prend la responsabilité de concevoir et de fabriquer à l’état neuf le système robotisé, et de mettre en service dans son entreprise.

Gordon Earle Moore (Moore’s Law)

Gordon Earle Moore (Moore’s Law)

Commentaires récents